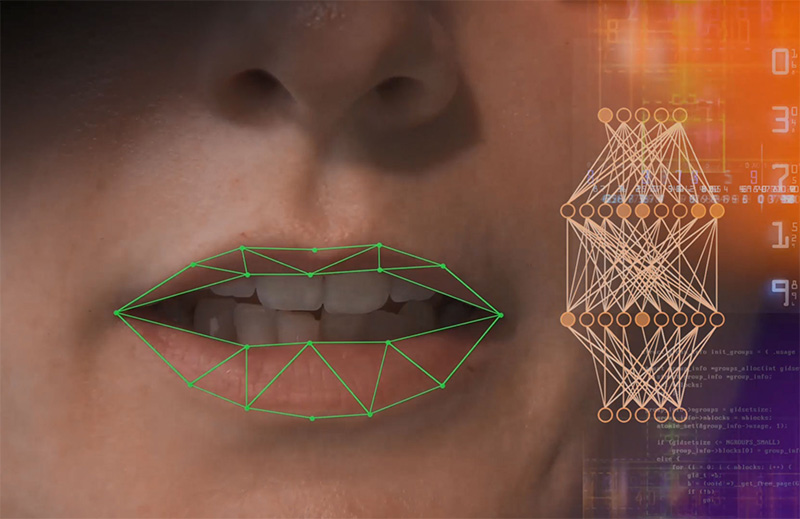

ปัจจุบันเริ่มมีการพัฒนา AI (Artificial Intelligence: ปัญญาประดิษฐ์) ที่อ่านภาพใบหน้ามนุษย์ แล้ววิเคราะห์จากริมฝีปากว่าเรากำลังพูดอะไร ได้แล้ว !!

ที่ผ่านมาเทคโนโลยีของกล้อง CCTV ที่มี AI ตรวจจับท่าทางการเดิน ตรวจจับพฤติกรรม (เช่น ชกต่อย ทำร้ายร่างกาย ทำลายทรัพย์สิน) หรือ จับอารมณ์สีหน้า มีออกมาใช้งานได้สักระยะเวลาหนึ่งแล้ว

แต่ในตอนนี้ บริษัท Liopa ซึ่งเป็นบริษัทเล็กๆ แห่งหนึ่งในอุทยานวิทยาศาสตร์ เมืองเบลฟาสต์ (Belfast) ประเทศไอร์แลนด์ ได้ทำวิจัยโครงการร่วมกับโรงพยาบาล Lancashire Teaching Hospitals ในประเทศอังกฤษ พัฒนาแอปพลิเคชันที่ชื่อว่า SRAVI (https://www.sravi.ai/index.html)

การทดลองใช้แอป SRAVI กับเคสคนไข้ที่ต้องเจาะคอใส่ท่อ (tracheostomies) โดยแค่ให้คนไข้ขยับปากพูด จากนั้นแอปจะอ่านริมฝีปาก แปลเป็นข้อความและเสียงออกมาให้ ซึ่งในทางภาษาเทคนิค เรียกว่า Automated Lip Reading for the Voice Impaired

ประโยชน์ก็คือ ช่วยให้ผู้ป่วยที่มีปัญหาพูดไมได้เพราะกล่องเสียง เส้นเสียงมีปัญหา หรือต้องเจาะคอ

สามารถเข้าดูเว็บไซต์ https://paperswithcode.com/sota/lipreading-on-lip-reading-in-the-wild ที่ได้รวบรวมบทความวิจัยทางด้านนี้ พร้อมระดับความแม่นยำในการอ่านริมฝีปากเอาไว้ด้วย ซึ่งกรณีที่ดีสุดอยู่ที่ประมาณ 80%

ข้อมูลโดย

ดร.มนต์ศักดิ์ โซ่เจริญธรรม

สำนักงานพัฒนารัฐบาลดิจิทัล (องค์การมหาชน)